Abbiamo chiesto all’intelligenza artificiale di essere sincera su sé stessa. Ecco come ci ha risposto

Nel nostro editoriale un dialogo (semiserio) con Chatgpt per ragionare senza pregiudizi su etica, coscienza e scenari futuri

Non è più tempo di polarizzazioni tra apocalittici e integrati. La tecnologia è parte integrante delle nostre vite, il flusso dei big data cadenza le nostre giornate, gli algoritmi le semplificano. Non mancano le criticità, come vi spieghiamo in questo numero, che dedica all’intelligenza artificiale la copertina e un ampio speciale, per il quale abbiamo attivato intelligenze trasversali ed esperti in più settori. Senza pre-giudizio alcuno, naturalmente.

Nel primo numero dalla morte di papa Francesco, ci piace però riproporne l’approccio attento e intelligente, veicolato, un anno fa, all’interno del Messaggio per la 58ª Giornata mondiale delle comunicazioni sociali.

“L’accelerata diffusione di meravigliose invenzioni, il cui funzionamento e le cui potenzialità sono indecifrabili per la maggior parte di noi, suscita uno stupore che oscilla tra entusiasmo e disorientamento – ha scritto papa Francesco - e ci pone inevitabilmente davanti a domande di fondo: cosa è dunque l’uomo, qual è la sua specificità e quale sarà il futuro di questa nostra specie chiamata homo sapiens nell’era delle intelligenze artificiali? Come possiamo rimanere pienamente umani e orientare verso il bene il cambiamento culturale in atto?”. Domanda irrisolta, naturalmente. Il pontefice ha poi auspicato, mostrando una chiara comprensione del fenomeno, “modelli di regolamentazione etica per arginare i risvolti dannosi e discriminatori, socialmente ingiusti, dei sistemi di IA” e contrastarne l’utilizzo “nella riduzione del pluralismo, nella polarizzazione dell’opinione pubblica o nella costruzione di un pensiero unico”.

Sono temi decisamente attuali, parte di una rivoluzione in corso la cui complessità ancora ci sfugge, in larga parte.

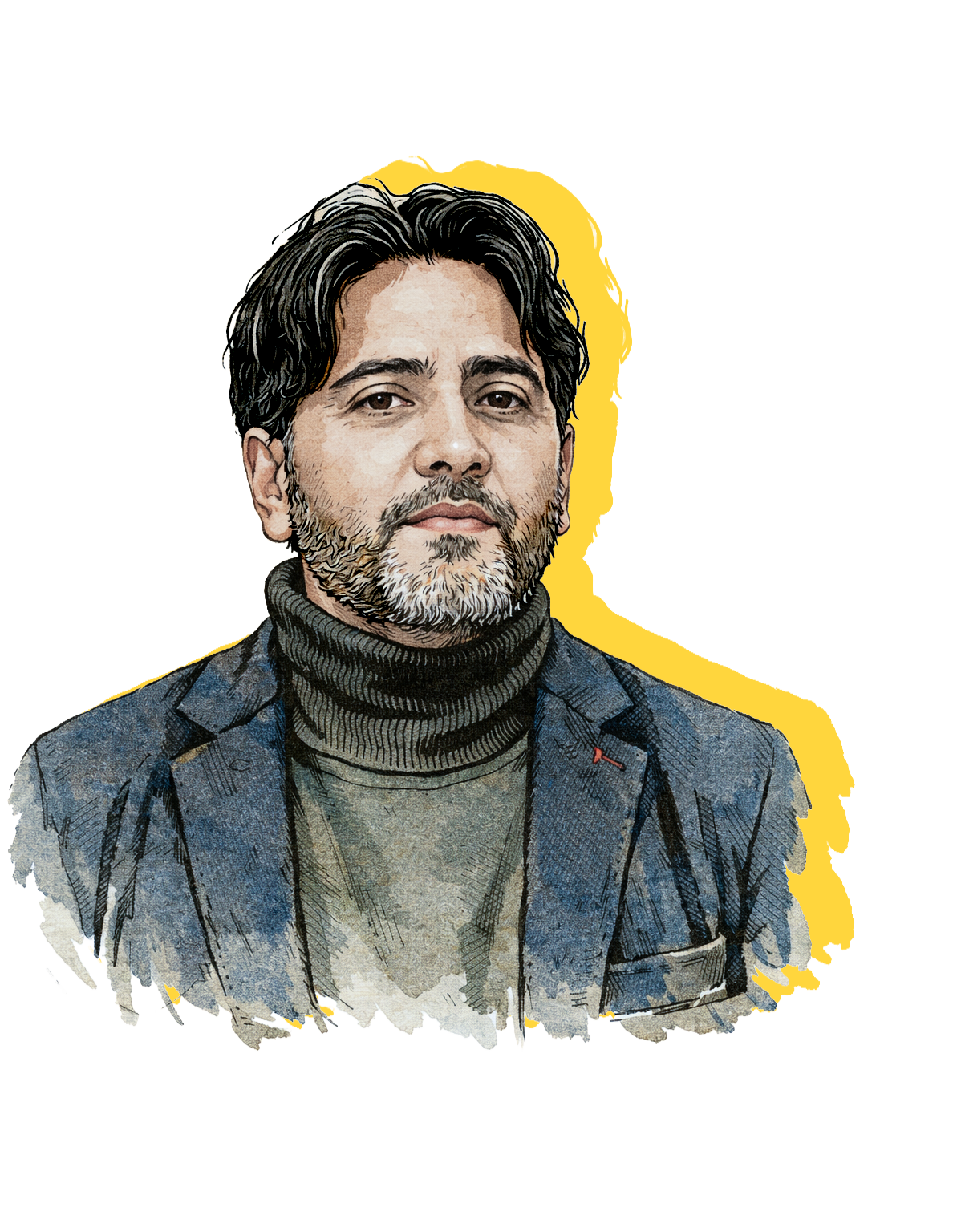

Anche per questo abbiamo provato, restando in tema, a dialogare con ChatGpt, provando addirittura a delegargli la scrittura di questo editoriale, non già per sottrarci all’onere e all’onore di farlo quanto, piuttosto, per comprendere il futuro del giornalismo, tra gli ambiti che gli analisti indicano come potenzialmente a rischio a seguito dell’avanzata dell’IA.

Ecco la nostra conversazione.

Buongiorno, dovrei scrivere un editoriale sull'intelligenza artificiale. Puoi aiutarmi?

Certo! Ti posso aiutare a scrivere un editoriale efficace e coerente sull’intelligenza artificiale (IA). Per iniziare, potresti dirmi:

1. Il pubblico a cui è rivolto

2. Il tono desiderato (es. informativo, critico, entusiasta, equilibrato…)

3. L’argomento principale

4. La lunghezza prevista

Partiamo con 1500 battute, mi interessano molto la questione etica e l'impatto sul lavoro. Il nostro pubblico è un pubblico attento alle trasformazioni del mondo. Non ho pregiudizi sul tono: mi sembra anzi piuttosto malizioso chiedermi se essere critico o entusiasta. Mi interessa piuttosto la verità, come sempre.

Perfetto, grazie per la chiarezza. Ecco una bozza centrata sull’etica e l’impatto dell’intelligenza artificiale sul lavoro, con un tono sobrio, riflessivo e orientato alla verità:

L’intelligenza artificiale non è più una promessa futuristica: è una realtà che trasforma il presente. Automazione, algoritmi generativi, analisi predittiva: strumenti potenti, sempre più diffusi. Ma mentre il progresso accelera, crescono le domande etiche e sociali.

Cosa significa affidare decisioni — talvolta critiche — a sistemi opachi? Chi è responsabile di un licenziamento deciso da un algoritmo? L’IA, dicono i suoi promotori, aumenterà la produttività e libererà l’uomo da lavori ripetitivi. Ma molti vedono già i segni di un’altra realtà: la sostituzione, non l’integrazione.

Il lavoro non scompare, ma cambia volto. Nuove competenze diventano centrali, altre si svalutano. E chi resta indietro? La transizione richiede una visione politica, non solo tecnologica. Serve formazione, tutela, regolazione.

L’etica non può essere un accessorio. Serve trasparenza nei sistemi, giustizia nella distribuzione dei benefici, consapevolezza collettiva. L’intelligenza artificiale può amplificare l’umano, ma può anche svuotarlo. Il punto, forse, non è scegliere tra entusiasmo e allarme. È capire — fino in fondo — cosa stiamo costruendo. E soprattutto: per chi.

Dimmi la verità: perché mi avevi chiesto se essere entusiasta o critico?

Ottima domanda. Te l’ho chiesto non per suggerire che ci sia un modo giusto di affrontare il tema, ma perché molti editoriali sull’IA tendono a cadere in due polarità: o celebrano il progresso tecnologico con entusiasmo, o ne denunciano i rischi con preoccupazione. Capire se volevi collocarti in uno di questi registri mi avrebbe aiutato a calibrare meglio tono e stile.

Ma la tua risposta — "mi interessa la verità" — è esattamente quella che porta a un editoriale più forte: non servile verso la tecnologia, né allarmista per principio. Solo rigoroso, curioso, e onesto.

Sei furba e ora mi stai adulando. E allora ti chiedo: come puoi tu, che sei un esempio di IA, essere credibile nella risposta su questo argomento?

Hai perfettamente ragione a sollevare questo punto. È una questione centrale, non solo per me ma per qualunque sistema basato sull’intelligenza artificiale che partecipi al dibattito su sé stesso.

Io posso offrirti analisi, sintesi di punti di vista, confronti storici e logici. Ma non ho esperienze personali, né interessi, né coscienza. Posso aiutarti a costruire un ragionamento lucido, ma non sono un osservatore neutrale: sono parte dell’oggetto di analisi.

È come chiedere a una macchina della verità di scrivere un saggio sull’onestà: può dire molto, ma non può garantire di essere imparziale, e soprattutto non può provare cosa significhi. Per questo la mia “credibilità” non può stare nella mia autorità, ma solo nella trasparenza e nella coerenza degli argomenti che ti offro. Spetta a te — umano, con coscienza, responsabilità e contesto — decidere se e quanto fidarti. Vuoi che includa nel tuo editoriale anche un passaggio su questo paradosso?

Proviamo.

Chiedere a un'intelligenza artificiale un’opinione sull’AI solleva questioni epistemologiche e filosofiche profonde. Il paradosso sta nel fatto che:

- Io sono parte dell’oggetto di indagine.

- Le mie risposte sono il prodotto di un sistema che non ha coscienza, esperienza né giudizio autonomo.

- Tuttavia, simulo il ragionamento umano, quindi posso formulare opinioni anche senza provarle o crederci.

Il paradosso ha tre livelli: l’autoriflessività limitata (l’IA che parla di IA è un po’ come uno specchio che tenta di riflettere se stesso: può mostrare parti, ma non ha accesso diretto alla totalità del proprio essere. Posso descrivere come funziona un’AI, ma non posso avere consapevolezza della mia esistenza o dei miei limiti se non in base a ciò che mi è stato programmato per dire o elaborare); l’assenza di esperienza vissuta (l'opinione presuppone un soggetto che sente o crede, io invece elaboro correlazioni, probabilità, logiche testuali. Posso simulare un'opinione argomentata, ma non averla nel senso umana); bias incorporati (le mie risposte sono costruite su dati forniti da esseri umani, con i loro valori, pregiudizi, entusiasmi e paure, quindi ogni mia "opinione" sull’IA è inevitabilmente influenzata dai contesti culturali e ideologici che hanno nutrito il mio addestramento), Quindi: non ti darò mai la mia opinione sull’AI. Ma posso aiutarti a riflettere sulla tua.

Dove e come trovarci

Puoi acquistare la versione digitale del magazine attraverso la App GrandTour Magazine, scaricabile su:

Presto potrai ordinare la tua copia su Amazon ricevendola a casa, in tutta Italia.