Cosa manca all'intelligenza artificiale per essere realmente sostenibile?

L’IA sta già guidando innovazioni che migliorano la salute, i farmaci e la qualità della vita. Rendere queste tecnologie più trasparenti e sostenibili significa ottenere diagnosi più affidabili, cure più efficaci e una ricerca più responsabile. Ecco i risultati di uno studio

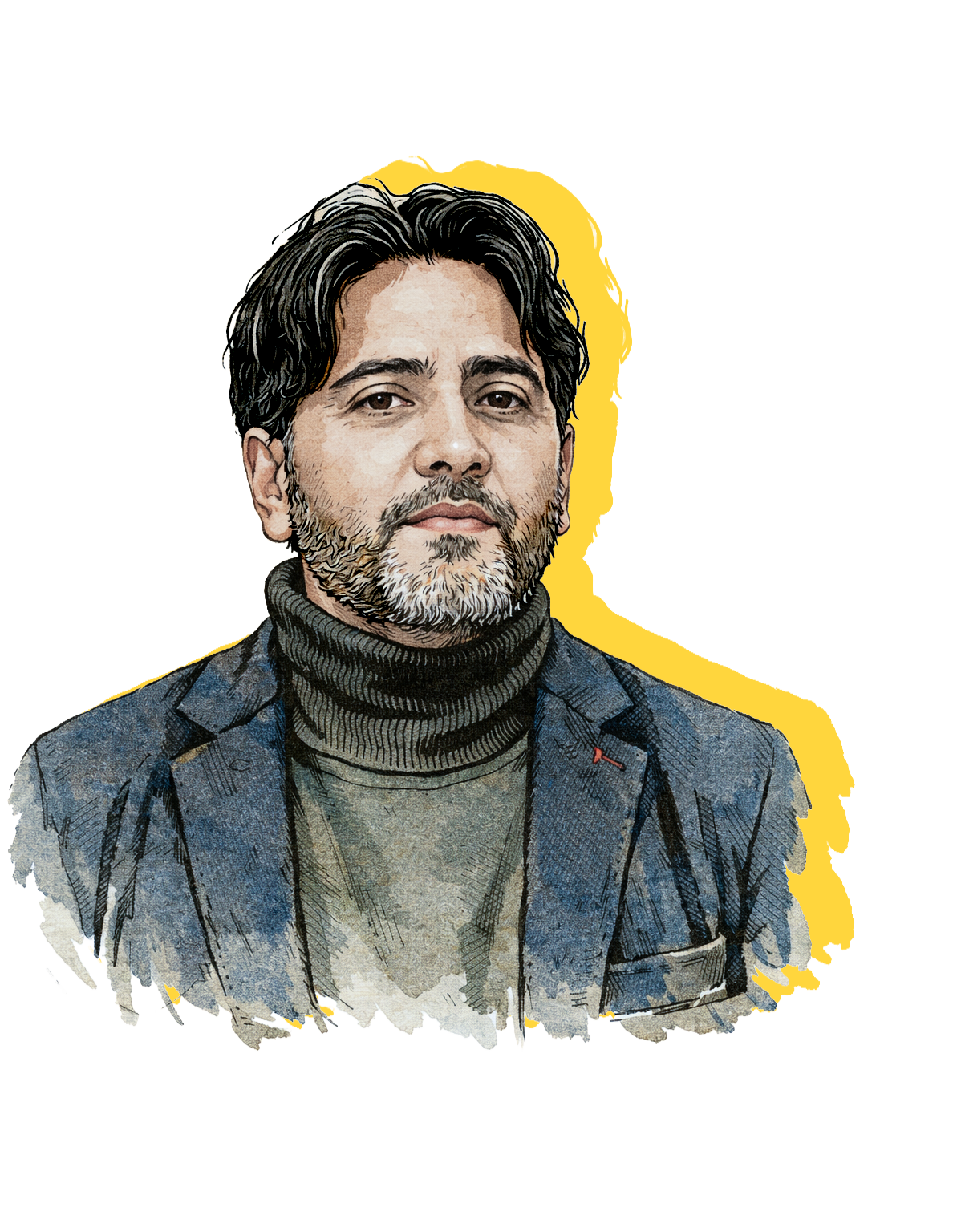

Rendere l’intelligenza artificiale riutilizzabile, affidabile e sostenibile dal punto di vista ambientale. Questo l’obiettivo dello studio Open and sustainable AI: challenges, opportunities and the road ahead in the life sciences pubblicato su «Nature Methods» e condotto da un team di ricercatori guidato dal professore Silvio Tosatto del dipartimento di Scienze biomediche dell’Università di Padova. Lo studio, che accende i riflettori sul ruolo sempre più centrale dell’intelligenza artificiale nelle scienze della vita, è stato sviluppato nell’ambito della rete europea ELIXIR e coinvolge esperti provenienti da 12 paesi.

Negli ultimi anni, l’intelligenza artificiale, e in particolare il machine learning, tecnologia che permette ai computer di imparare dai dati e migliorare le proprie previsioni senza essere programmati passo per passo, ha trasformato profondamente la biologia. In pratica, questi sistemi utilizzano grandi quantità di informazioni (ad esempio dati genetici o clinici) e individuano schemi utili per fare previsioni. Grazie a questi strumenti, oggi è possibile, per esempio, prevedere la struttura delle proteine o analizzare enormi quantità di dati sanitari.

Tuttavia, questa crescita rapidissima ha portato con sé anche nuove criticità.

Affidabilità: possiamo davvero fidarci dei risultati prodotti dall’AI?

È una delle domande che emergono con forza. Molti studi pubblicati negli ultimi anni, decine di migliaia solo nel 2024, non descrivono in modo chiaro i metodi utilizzati. Questo rende difficile verificare i risultati o riutilizzarli. Senza riproducibilità, la scienza perde solidità. Se un risultato non può essere verificato, il rischio è costruire conoscenza su basi fragili.

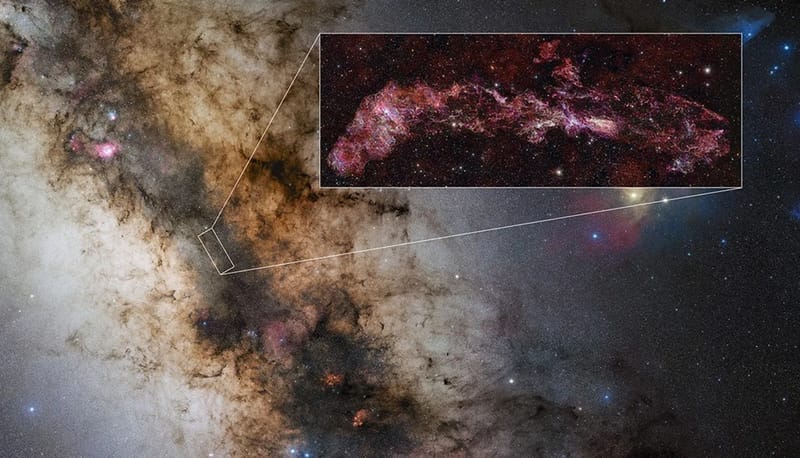

Ambiente: consuma così tanto l’IA?

La risposta è sì: l’addestramento dei modelli richiede enormi risorse computazionali, spesso alimentate da energia non rinnovabile. Anche la ricerca scientifica, quindi, deve fare i conti con il proprio impatto ambientale. In questo scenario si inserisce ELIXIR, un’infrastruttura di ricerca che collega 24 paesi europei e coordina risorse, dati e strumenti per le scienze della vita. Attraverso la co-progettazione di database, software, risorse di formazione e infrastrutture computazionali, ELIXIR promuove un ecosistema in cui dati e modelli possano essere utilizzati in modo trasparente, accessibile e sostenibile.

«Il nostro studio offre una proposta concreta alle sfide dell’Intelligenza artificiale che si concretizza in 9 raccomandazioni pratiche per sviluppare una Open and Sustainable AI (OSAI) lungo tutto il ciclo di vita dei modelli di machine learning – spiega il professore Silvio Tosatto -. Le raccomandazioni si concentrano su tre dimensioni chiave La prima, rendere l’AI riutilizzabile, ovvero dati e modelli devono essere descritti in modo standardizzato, così da poter essere trovati e riutilizzati anche da altri ricercatori. La seconda, garantire la riproducibilità: codice, metodi e condizioni sperimentali devono essere condivisi in modo chiaro, per permettere verifiche indipendenti. La terza, ridurre l’impatto ambientale: è necessario adottare pratiche di “Green AI”, monitorando e limitando il consumo energetico dei sistemi.» Un elemento distintivo del lavoro è inoltre la mappatura di oltre 300 strumenti e risorse già disponibili, che consentono ai ricercatori di applicare concretamente queste raccomandazioni, colmando il divario tra teoria e pratica.

Un impatto che va oltre i laboratori

Questo studio ha ripercussioni che vanno ben oltre il mondo della ricerca: l’intelligenza artificiale sta già guidando innovazioni che migliorano la salute, i farmaci e la qualità della vita. Rendere queste tecnologie più trasparenti e sostenibili significa ottenere diagnosi più affidabili, cure più efficaci e una ricerca più responsabile. In sintesi, lo studio segna un passo decisivo: non basta sviluppare strumenti sempre più potenti, bisogna anche garantire affidabilità, condivisione e sostenibilità. Le raccomandazioni OSAI offrono una roadmap concreta per il futuro dell’AI nelle scienze della vita, con benefici tangibili per la comunità scientifica e per la società.